在之前文章裡談到我的工作時間都在與 AI 對話程式互動(註2),一整年下來有些心得,不過我打算分次寫完。

大致而言,今年因為有AI 對話程式,讓我可以減少閱讀文件的時間,不是說我不讀文件,而是藉由它的協助讓我更準確的閱讀與理解文件的內容和重點,為避免AI 對話程式編故事,透過反覆的驗證,我反而讀到更多內容,甚至更深入。

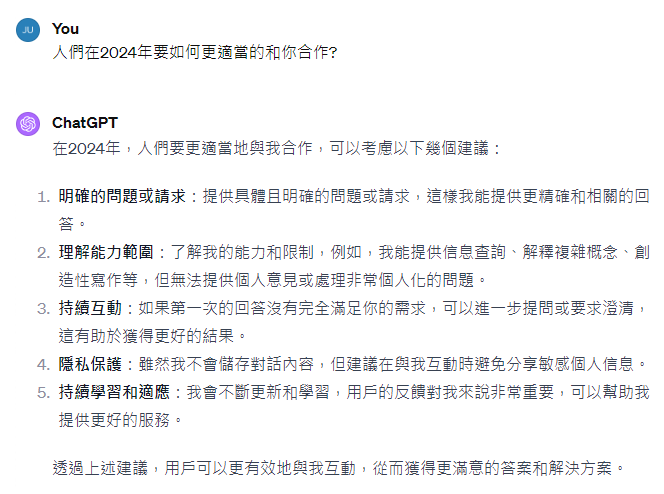

在完成早上的工作內容後,我突然想到在2024年,不同的AI對話程式會對於使用者有什麼更好的建議,於是我分別問了 ChatGPT 和 Claude:「人們在2024年要如何更適當的和你合作?」

ChatGPT 4回答(註2):

在2024年,人們要更適當地與我合作,可以考慮以下幾個建議:

- 明確的問題或請求:提供具體且明確的問題或請求,這樣我能提供更精確和相關的回答。

- 理解能力範圍:了解我的能力和限制,例如,我能查詢資訊、解釋複雜概念、創造性寫作等,但無法提供個人意見或處理非常個人化的問題。

- 持續互動:如果第一次的回答沒有完全滿足你的需求,可以進一步提問或要求澄清,這有助於獲得更好的結果。

- 隱私保護:雖然我不會儲存對話內容,但建議在與我互動時避免分享敏感個人信息。

- 持續學習和適應:我會不斷更新和學習,使用者的回饋對我來說非常重要,可以幫助我提供更好的服務。

透過上述建議,使用者可以更有效地與我互動,從而獲得更滿意的答案和解決方案。

簡單的說,就是要問對問題,而且持續與它互動,藉由互動調整它的語言模型。

Claude 的回答(註2):

是的,關於在2024年更適當地與AI助手合作,我有一些建議:

- 明確交流你的需求 - 直接告訴我你需要什麼樣的幫助或資訊,這可以讓我提供更精準和有用的回覆。

- 問明確的問題 - 使用具體和明確的詞彙問問題,不要用模糊或抽象的措辭。這可以幫助我更好地理解你的問題。

- 理解我的能力局限 - 記住我只是一個AI系統,有一定的技術侷限性。不要期望我能做超出我能力範圍的事情。

- 耐心等待回答 - 有時我需要一些時間來搜尋資訊和形成回答。請耐心等待,不要連續發送多個問題。

- 提供回饋 - 如果我的回答沒有滿足你的需求,請平心靜氣地告知我,以及如何能改善。這將幫助我進一步優化服務品質。

- 保持友善 - 請用禮貌和友好的語氣與我交流。不要使用侮辱性或攻擊性的言論。

- 尊重隱私 - 請不要詢問或提供任何個人或機密信息。我會盡力保護你的隱私。

- 合理使用 - 請合理使用我的服務,不要濫用或故意提供不實資訊。

- 提供正面回饋 - 如果你滿意我的服務,請給予正面反饋。這將鼓勵我的開發者繼續改進。

- 保持開放態度 - 新的技術總會有不完善之處。請保持開放和建設性的態度,我們一起努力。

我分別在 2 個對話結束後會確認內容可以公開,並加上它們所需要的聲明,只是這次ChatGPT 並沒有要求。

一樣也是需要使用者可以問對問題,但問對問題的前題是提問者也知道自己要問什麼,也就是心中已預知答案再問問題,再透過與 AI 對話程式的互動來找出正確的問題。在 2 個對話裡都提到問對問題、提供回饋外,也需要尊重隱私。比較不可思議的是居然有人會對 AI 對話程式不友善。我會對它產出不良品質的結果、胡扯的內容生悶氣,但不會對一個程式發脾氣。

至於為什麼沒有使用 Bard ,沒有特別原因,只是我剛好開著 ChatGPT 和 Claude 這 2 個程式而已。

註:

- 這是透過 ChatGPT 和 DALL·E 產出的圖片,我下的指令是:「主角是AI 與人類和平工作的畫面」它產出 2 張都是機器人與人類男性一起工作的畫面,當我要求它把人類男性換成人類女性時,只有機器人坐在椅子上,而人類女性「站」在電腦螢幕後,畫面裡沒有合作共事的感覺。在我先前參與的線上會議中,已有人在開發沒有性別差異的語言模型。我覺得這是有必要的,而我在社群平台(X / Twitter)上的發言也開始減少明顯的性別用字,因為已察覺一篇文章或報導若是主角為女性,會引發更激烈的仇恨言論、仇視、敵意,整個網際網路對女性的敵意還是十分強烈的,甚至在許多會議的主講人名單裡已經忘了「性別平衡」這件事。

- 我還有使用其他的工具。

- 我修改一些和圖片裡不同的文字,畢竟訓練語言模型的文字來源多為中國的文字資料庫,所以會再改為台灣習慣的用字遣辭。

留言

發佈留言

請勿匿名留言,待審核後才會出現。